some week has passed but I’m still struggling. I have a doubt before open an issue: it is corret my understanding that skip_words added in _common.yaml should work to ALL the default intent?

Whisper works good for me in Italian. model large-v2 float16

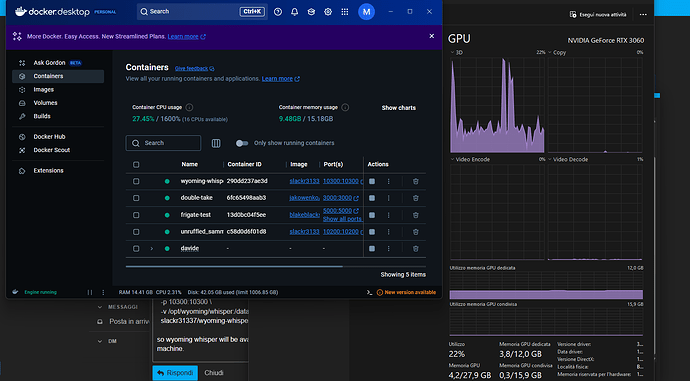

I’m using wyoming whisper hosted in Windows 11 in docker. I use WLS 2 and docker on Windows, Gpu Nvidia rtx 3060 12 gb.

I’m running containers in Windows and it woks super good using in the same time:

- Frigate

- compre face

- double take

- wyoming whisper

- wyoming piper

Just install Wsl Ubuntu, update it, install docker Windows and make sure you have all the drivers installed.

Then open Ubuntu and in the terminal run the docker run command.

docker run -d \

--name wyoming-whisper \

--restart unless-stopped \

--gpus all \

-e MODEL=large-v2 \

-e LANGUAGE=it \

-e COMPUTE_TYPE=float16 \

-e BEAM_SIZE=5 \

-p 10300:10300 \

-v /opt/wyoming/whisper:/data \

slackr31337/wyoming-whisper-gpu:latest

so wyoming whisper will be available on port 10300 of Ip of your windows machine.